近日,新葡的京集团8814智能决策与控制技术研究团队在人工智能领域重要期刊Engineering Applications of Artificial Intelligence(IF 8.0,中国科学院二区Top期刊)上发表了题为“YH-Pose: Human Pose Estimation in Complex Coal Mine Scenarios”的学术研究论文。硕士研究生董祥庆为论文第一作者,王西超老师为论文通讯作者,我校为论文第一单位。

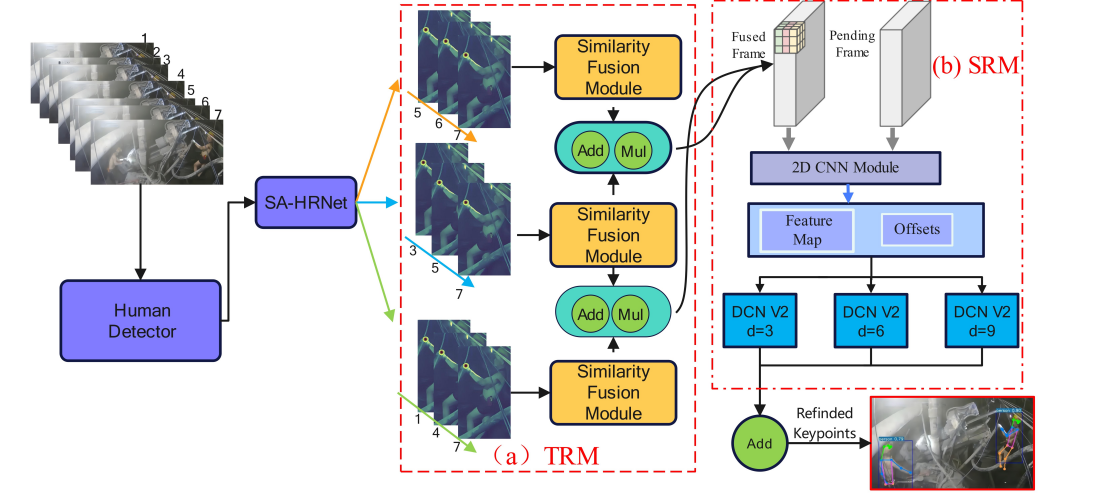

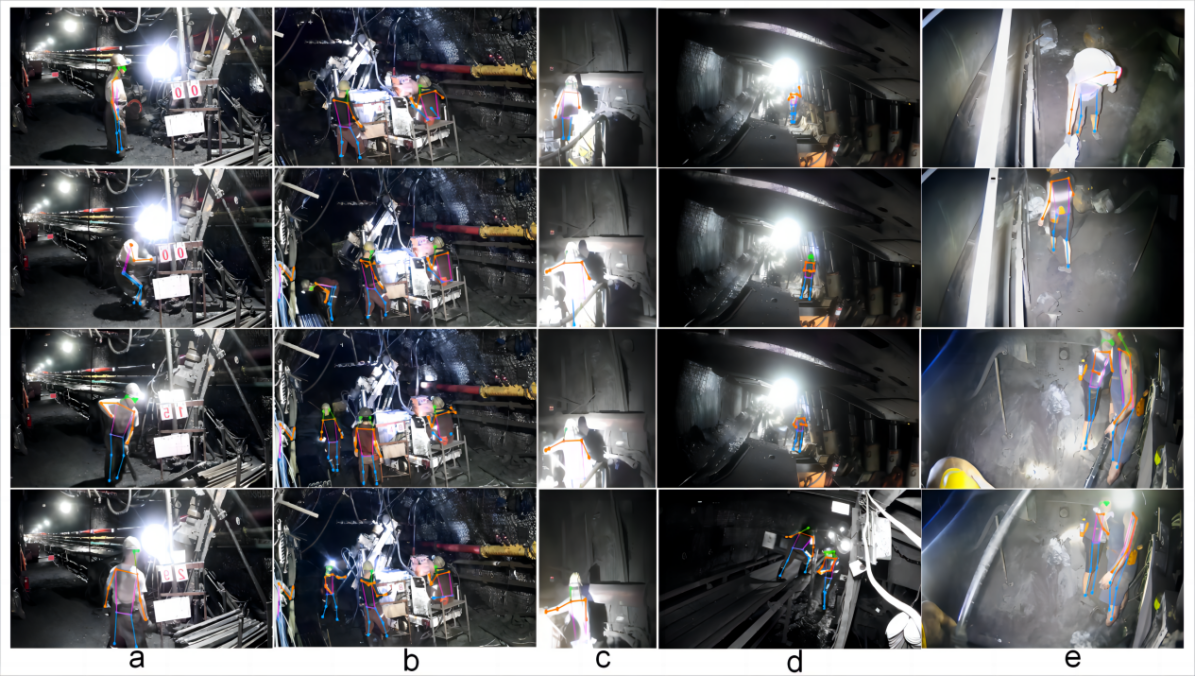

在复杂的工业场景下进行人体姿态估计是具有挑战性的。该场景下的监控视频帧存在亮度不均匀、图像细节模糊和噪声过多等问题。最新主流的人体姿态估计方法对高质量的静态图像具有良好的检测性能,但在工业场景中,模型的准确性和预测率会大幅度降低。针对这些问题,智能决策与控制技术研究团队提出了一种适用于复杂工业场景下的人体姿态估计方法YH-Pose,该框架努力合并来自邻近视频帧的额外视觉证据,以促进当前帧的姿态估计。首先,引入一个人检测器来定位人在视频帧中的位置并提取全局特征。这可以为后面关键点检测提供很好的初始化,使训练过程快速收敛。其次,利用热图对关节位置进行编码为高斯峰值,并设计了一个时间道路模块(TRM),以一定的间隔对视频帧进行编码。该模块通过不同帧率进行分组融合时空信息。最后,空间道路模块(SRM)从融合的关键点上下文特征中进行学习,并预测下一帧中的关键点的位置。此外,团队还提出了一个名为Colliery-1的工业场景人体姿态估计通用数据集,在Colliery-1数据集上的实验结果表明,该框架在训练集和测试集上的平均准确率分别为82%和80%。此外,该框架对人体姿态的预测率为94.2%,达到了SOTA,为复杂工业场景下的人体行为识别研究做出了贡献。

YH Pose框架的总体概述

YH-Pose对复杂工业场景不同作业区域检测的可视化结果

论文链接:

https://www.sciencedirect.com/science/article/pii/S0952197623015221